Explore Assistantのバックエンドを設定することは、LookerとBigQueryなどのインフラを連携させるための重要なステップです。今回は、Terraformを使用してBigQueryをバックエンドに設定し、AIモデルを動作させるためのステップを詳しく説明します。

はじめに

Explore Assistantのバックエンドを設定することは、LookerとBigQueryなどのインフラを連携させるための重要なステップです。このセクションでは、Terraformを使用してBigQueryをバックエンドに設定し、AIモデルを動作させるためのステップを詳しく説明します。

前回の記事はこちら:Looker Explore Assistant構築パート1: 機能の理解と環境構築編 I. アカウントへの許可の付与まず、必要な権限を適切に設定することが不可欠です。これにより、サービスアカウントが適切にリソースへアクセスし、Explore Assistantの機能がスムーズに動作するようになります。以下のロールをアカウントに付与します。

- BigQuery 接続管理者

- サービスアカウント管理者

- サービスアカウント トークン作成者

- ストレージ管理者

- サービス利用消費者

- シークレットマネージャー管理者

これらのロールを適切に設定することで、データアクセスのセキュリティを保ちながら、Explore Assistantが円滑に動作します。

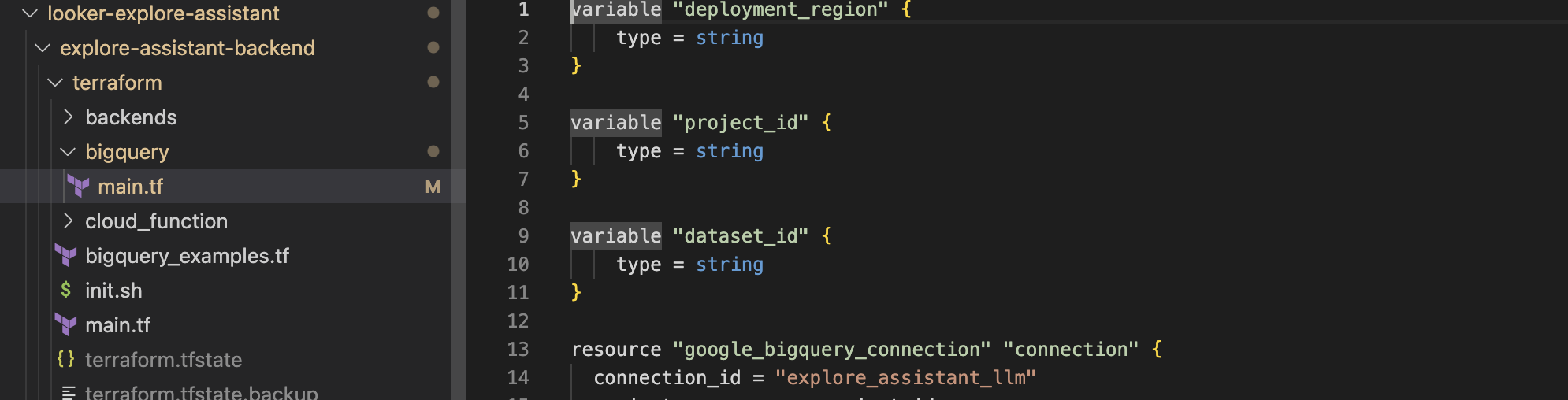

II. ステップバイステップのセットアップこのセットアップでは、Terraformを使用して、Vertex AIのGemini ProモデルとBigQueryを使用するバックエンドを構築します。この手順に従うことで、Looker Explore Assistantの基盤を整えます。

ステップ1: Cloud Shellの起動とフォルダ移動

1.Cloud Shellの起動

前回cloneした、looker-explore-assistantのあるCloud Shellのを開きます。

2.リポジトリへの移動

ターミナルで次のコマンドを実行して、リポジトリ内の適切なフォルダへ移動します。

cd looker-explore-assistant/explore-assistant-backend/terraform

認証トークンの生成 次に、認証トークンを生成します。

openssl rand -base64 32 > .vertex_cf_auth_tokenステップ2: variables.tfvarsの設定

Terraformが使用する変数ファイルを設定します。variables.tfvarsファイルに以下の内容を追加し、プロジェクトIDやリージョンを適切に設定します。

deployment_region = "asia-southeast1"

project_id = "your_project_id"

use_bigquery_backend=1

use_cloud_function_backend=0この設定により、BigQueryをバックエンドとして使用する構成が整います。

ステップ3: Terraformの実行

次に、Cloud ShellでTerraformを実行し、インフラをデプロイします。以下のコマンドを使用してください。

export TF_VAR_project_id="your_project_id"

export TF_VAR_use_bigquery_backend=1

export TF_VAR_use_cloud_function_backend=0

terraform init

terraform plan

terraform applyterraform applyを実行後、成功メッセージが表示されれば、バックエンドの設定が完了です。

ステップ4: サービスアカウントの認証キーを作成

次に、Google Cloud IAMでサービスアカウントの認証キーを作成します。

1.GCPコンソールのIAMページへ移動

左側のナビゲーションから「IAMと管理」>「サービスアカウント」を選択し、looker-explore-assistant-sa@から始まるサービスアカウントを探します。

2.キーの作成

サービスアカウントの「KEYS」タブで「キーの追加」>「新しいキーの作成」を選択し、キータイプとして「JSON」を選び、キーを保存します。

このキーは、後のステップで認証に使用されます。

ステップ5: BigQueryのLLMモデル作成

Explore Assistantが利用するAIモデルをBigQueryに作成します。以下のクエリを使用して、Gemini ProモデルをBigQueryに設定します。

CREATE OR REPLACE MODEL explore_assistant.explore_assistant_llm

REMOTE WITH CONNECTION projects/your_project_id/locations/us-central1/connections/explore_assistant_llm

OPTIONS (endpoint = 'gemini-1.5-flash')これで、LLMモデルが作成され、BigQueryとの連携が可能になります。

入力と出力の例の設定

次に、Explore Assistantにアップロードする例のJSONファイルをBigQueryにロードします。この手順では、事前に作成されたサンプルデータを使用し、モデルを微調整していきます。

仮想環境のセットアップ Cloud Shellで以下のコマンドを実行し、仮想環境を作成します。

python3 -m venv .venv

source .venv/bin/activate

pip3 install -r requirements.txt

JSONファイルのアップロード 次に、以下のコマンドを使用して、サンプルデータをBigQueryにアップロードします。

python load_examples.py \\

--project_id your_project_id \\

--explore_id thelook_japanese_bq:order_items \\

--table_id explore_assistant_examples \\

--json_file examples.jsonまとめ

今回の記事では、Looker Explore AssistantのバックエンドをTerraformを使用して構築する方法について説明しました。BigQueryとVertex AIのGemini Proモデルを連携させ、Explore Assistantを動作させるための基本的なステップを解説しました。

次回の記事では、フロントエンドのセットアップに移り、Explore Assistantの具体的な使用方法や、Lookerとの統合方法について詳しく見ていきます。